机器学习系列五【如何科学评估分类模型(混淆矩阵、准确率、召回率与 ROC 曲线)】

机器学习系列五【如何科学评估分类模型(混淆矩阵、准确率、召回率与 ROC 曲线)】

JayVei机器学习系列五:是骡子是马?如何科学评估分类模型(混淆矩阵、准确率、召回率与 ROC 曲线)

欢迎来到“机器学习系列”的第五篇文章!在前面的系列中,我们已经掌握了如何用逻辑回归来解决二分类问题(比如判断邮件是否为垃圾邮件)。

现在,假设你辛辛苦苦训练好了一个分类模型,并在测试集上跑出了一个结果。这时候老板走过来问:“你的模型效果怎么样?”

如果你只回答:“我的模型准确率高达 99%!”——那么你可能要小心了,因为在机器学习的世界里,“准确率”往往是一个极具欺骗性的陷阱。

今天,我们就来聊聊如何科学、全面地评估一个分类模型。我们将深入了解混淆矩阵,理清精确率与召回率的爱恨情仇,并学会看懂那条高端大气的 ROC 曲线。

1. 准确率(Accuracy)的致命陷阱

准确率(Accuracy) 是我们最直觉的评估指标:预测对的样本数 / 总样本数。

听起来很完美对吧?但在处理数据不平衡(Imbalanced Data)的情况下,准确率会彻底失效。

举个极端的例子: 假设我们在做罕见病筛查,1000 个病人中只有 1 个人真正患病(正类),999 个人是健康的(负类)。如果我写一个极其“弱智”的代码:return "健康",也就是不管谁来,我都预测他没病。

在这个测试集上,我的代码预测对了 999 个人,准确率高达 99.9%! 但这个模型有什么用?它连唯一那个真正需要被找出来的病人都漏掉了,在医学上这是一个医疗事故。

为了避免被这种“虚假的高分”蒙蔽双眼,我们需要祭出分类评估的终极法宝——混淆矩阵。

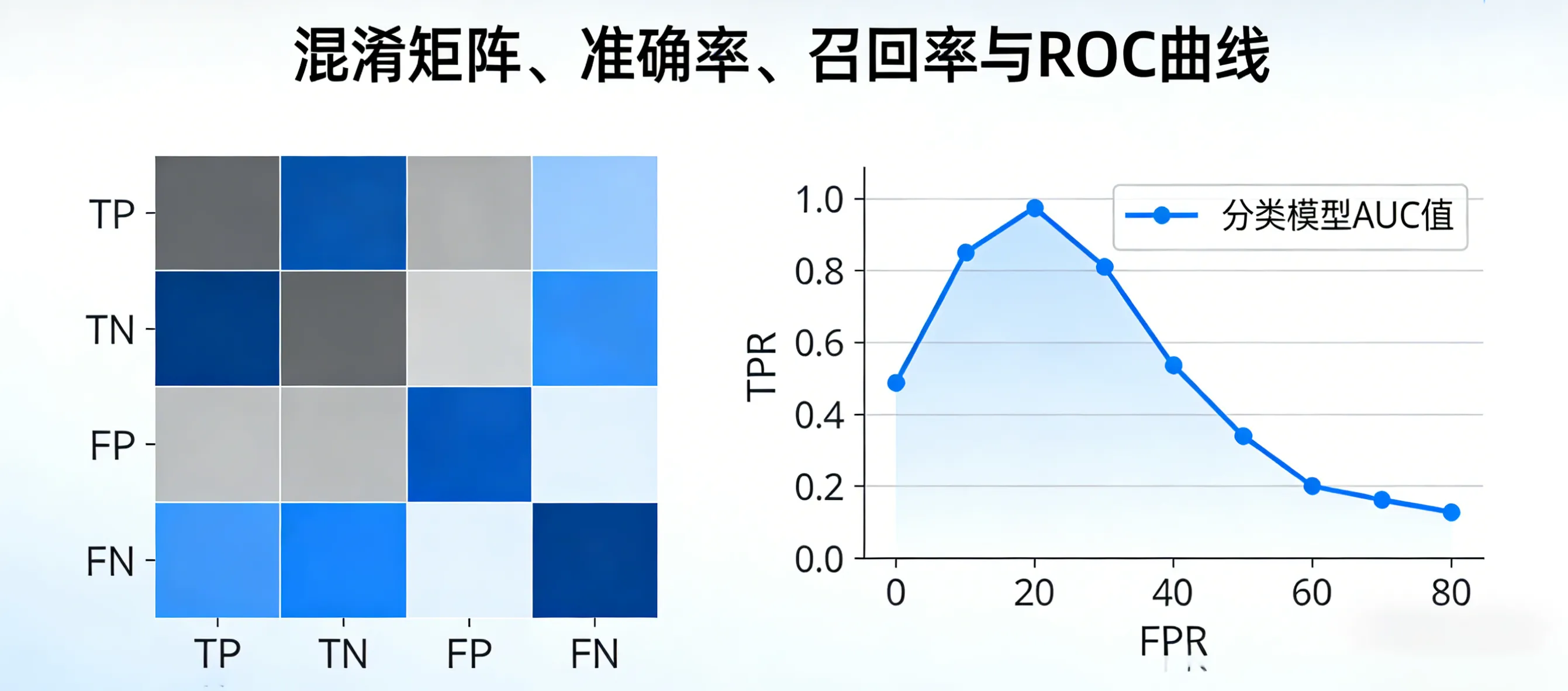

2. 一切评估的基石:混淆矩阵(Confusion Matrix)

混淆矩阵就像是模型考试的“成绩单明细”。对于二分类问题,它是一个 2x2 的表格,把模型的预测结果和真实情况进行了四种组合。

为了方便记忆,我们假设目标是“找出带病的患者”(患病 = 正类 Positive,健康 = 负类 Negative)。

| 模型预测:正类 (Positive / 有病) | 模型预测:负类 (Negative / 没病) | |

|---|---|---|

| 真实情况:正类 (有病) | **TP (True Positive / 真正例)**: 预测有病,确实有病。神医! |

FN (False Negative / 假负例): 预测没病,实际有病。漏诊! |

| 真实情况:负类 (没病) | FP (False Positive / 假正例): 预测有病,实际没病。误诊! |

**TN (True Negative / 真负例)**: 预测没病,确实没病。常态。 |

💡 记忆小贴士: 第一个字母 T/F 代表预测对没对(True/False),第二个字母 P/N 代表模型的预测结果是什么(Positive/Negative)。

通过这个矩阵,我们就把粗糙的“准确率”拆解成了四个维度的细节。有了这四个基础数据,我们就能推导出两个极其重要的指标:精确率(Precision)和召回率(Recall)。

3. 鱼与熊掌的博弈:精确率 vs 召回率

3.1 召回率 (Recall) —— “宁肯错杀一千,不可放过一个”

召回率又叫查全率,它的公式是:

$$Recall = \frac{TP}{TP + FN}$$

物理意义:在所有真实有病的人中,模型成功找出了多少个?

适用场景:癌症筛查、地震预警。在这些场景中,漏报(FN)的代价极其惨重。即使误报(FP)导致了一些虚惊一场,我们也必须保证极高的召回率,把真正的危险全部揪出来。

3.2 精确率 (Precision) —— “狼来了,我不信”

精确率又叫查准率(虽然标题中没写,但它通常和召回率成对出现),公式是:

$$Precision = \frac{TP}{TP + FP}$$

物理意义:在模型预测有病的所有人中,到底有多少人是真的有病?

适用场景:垃圾邮件拦截、嫌疑人抓捕。在这些场景中,误报(FP)的代价很高。如果模型天天把正常邮件当垃圾拦截,或者冤枉好人,用户就会崩溃。所以我们需要极高的精确率,确保一旦模型说“有”,就基本一定是真的。

3.3 跷跷板效应与 F1-Score

在现实中,精确率和召回率就像跷跷板的两端,通常是矛盾的。你想多抓出几个真正的病人(提高 Recall),就不可避免地会把一些健康人也抓进来(降低 Precision)。

为了综合考量这两个指标,我们引入了它们的调和平均数——F1 分数(F1-Score):

$$F1 = 2 \times \frac{Precision \times Recall}{Precision + Recall}$$

F1 分数越高,说明模型的综合性能越强大、越均衡。

4. 全局视角:ROC 曲线与 AUC 值

逻辑回归输出的是一个 $(0, 1)$ 之间的概率值。我们通常把阈值设为 0.5:大于 0.5 判为正,小于 0.5 判为负。但如果我们将阈值调整为 0.3 或 0.8 呢?不同阈值下的混淆矩阵会截然不同!

为了展示模型在所有可能阈值下的整体表现,我们画出了 ROC 曲线(Receiver Operating Characteristic Curve)。

- 横轴(FPR, 假正例率):真实负样本中,被误判为正的比例(误报率)。

- 纵轴(TPR, 真正例率):就是我们的召回率(找出真目标的比例)。

一条优秀的 ROC 曲线,应该尽可能地向左上角贴近——这意味着模型可以在极低的误报率下,实现极高的召回率。

AUC(Area Under Curve):

光看曲线不方便对比,于是我们计算了 ROC 曲线下方的面积,也就是 AUC 值。

- AUC = 0.5:模型跟瞎猜没区别(对角线)。

- 0.5 < AUC < 1:模型有预测价值。

- AUC = 1:完美模型(现实中几乎不存在)。

通常,AUC 值大于 0.8 就说明模型已经具有非常优秀的分类区分能力了!

5. 总结

再遇到老板问你模型好不好时,你可以这样专业地回答:

- 如果是罕见病筛查,你要看混淆矩阵和召回率(Recall)。

- 如果是垃圾邮件拦截,你要看精确率(Precision)。

- 如果要综合衡量两者的平衡,看 F1-Score。

- 如果想评估模型区分正负样本的整体硬实力,直接甩出 ROC 曲线和 AUC 分数!

至此,关于机器学习“评估”的核心指标已经全部交给你了。接下来,你终于可以放心地带着模型去解决真实的业务挑战了!